3月12日,以“ ai 科技、慧享未来”为主题的2026年中国家电及消费电子博览会(awe 2026)在上海新国际博览中心开幕。杨浦企业声网携两项新成果亮相:对话式ai开发套件r2系列产品,以及“泛ipc(网络摄像机)实时交互+智能处理引擎”。同时,他们带来的数十款搭载其技术的智能硬件,展示了实时音视频技术(rtc)如何让机器与人的互动变得更自然。

一年三次迭代

开发套件有了视觉和运动能力

走进声网展台,最引人注目的是一款名为“陆卡卡”的桌面机器人。当你走进它时,它会转动头部“注视”你,你指向某个方向,它能循声望向那里。这种“被看见”“被注视”的体验,让机器不再只是被动应答的工具,而更像一个有生命的陪伴者。

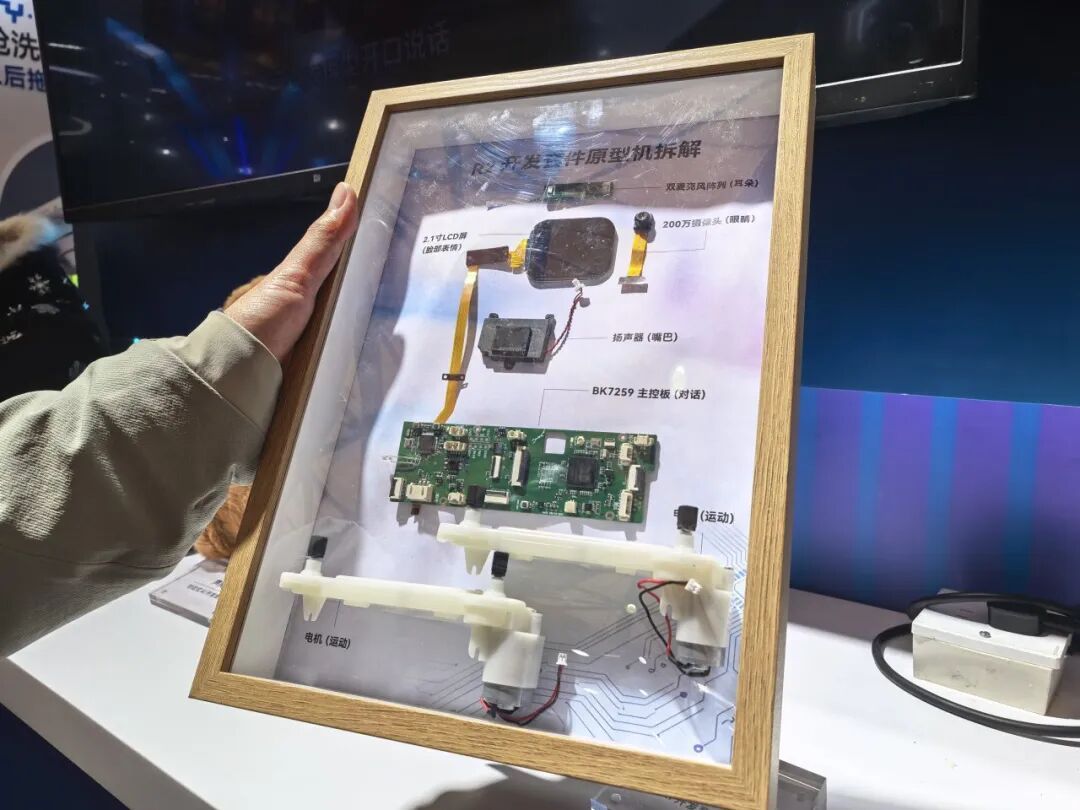

支撑这种体验的,是声网最新发布的r2全场景ai机器人开发套件原型机。与一年前的r1套件相比,r2最大的变化是增加了本地视觉识别和多自由度运动控制能力。这意味着,搭载r2的硬件不仅能听懂人说话,还能看懂人的手势、识别人脸轨迹,并做出相应的动作。

据了解,声网在去年3月首次发布对话式ai开发套件r1,重点解决了实时对话中的背景降噪和智能打断问题,让用户和机器聊天时可以像和人聊天一样自然,不用每次都说“小x小x”这样的唤醒词。该套件发布至今,出货量已达百万级,被广泛应用于ai玩具、陪伴机器人等产品中。去年9月,针对移动化需求,声网又联合芯片企业推出了支持4g通信的版本,让ai硬件可以随时随地保持在线,满足车载等场景。

从r1到r2,一年内三次迭代,声网为硬件厂商提供了一套从“能听会说”升级到“能看会动”的技术方案。业内人士认为,随着运动控制和端侧视觉能力的加入,未来具身智能机器人将是重要发展方向。

开源底层技术

吸引更多芯片厂商加入生态

今年年初,声网宣布将核心的硬件抽象层项目aosl在github上全面开源。简单来说,aosl就像一套通用的“翻译器”,让不同操作系统和芯片都能顺畅地运行声网的实时互动技术。对芯片厂商来说,接入aosl意味着他们的硬件从出厂起就具备了“声网级”的实时互动能力。

本次awe上,声网首次展示了最新的开源生态成果。这种“开源底座+商业套件”的模式,正在吸引越来越多芯片厂商加入,让硬件创新从过去的“一次性定制”转向更高效的生态协作。

为出海设备铺路

全球秒见图,弱网不断连

除了对话式ai套件,声网还发布了一款面向摄像头、扫地机器人、3d打印机、宠物喂食器等设备的“泛ipc实时交互+智能处理引擎”。

随着越来越多中国智能设备走向海外,用户对这类产品的要求也越来越高:在一些网络不太好的地区,也能秒速打开家里的监控画面;扫地机器人走到庭院角落、割草机穿行在花园边缘,依然能保持连接,不会“失联乱撞”;宠物出现异常时能第一时间收到提醒……

声网的解决方案集成了四项核心能力:依托自研的全球实时网络,覆盖200多个国家和地区,建联成功率超过99.9%,首次打开画面的时间达到毫秒级,真正实现“秒见图”;在极端弱网环境下,即使音视频数据丢失80%,仍能保障画面流畅和指令实时响应;在传输过程中可以同步完成宠物检测、人脸识别等ai分析,检测结果实时推送到用户端;支持多人同时观看和交互,并符合全球多个地区的数据安全法规。

回顾过去十年,无论是手机app还是智能硬件,产品形态在不断变化,但人们希望用最自然的语言和机器交流的愿望始终未变。当ai硬件从“功能机”向“情感机”进化,实时互动的体验好坏,正成为决定产品成败的关键。作为全球领先的实时音视频云服务商,声网正通过一次次技术迭代,把复杂的实时互动能力变成标准化的模块,为万物智联的时代铺设底层通路。

文字:毛信慧

图片:毛信慧

编辑:文茜婷

*转载请注明来自上海杨浦官方微信

上观号作者:上海杨浦